Η κυκλοφορία του ανοιχτού κώδικα Deepseek προκάλεσε όχι μόνο αναταράξεις στον τομέα της τεχνητής νοημοσύνης λόγω των επιδόσεών του έναντι σε μεγαθήρια όπως το ChatGPT την OpenAI αλλά και επειδή έδωσε την δυνατότητα σε όλους να το τρέξουμε στον υπολογιστή και το κινητό μας. Στον οδηγό που θα διαβάσετε, θα μάθετε πως μπορούμε να το κάνουμε εγκατάσταση σε ένα Laptop μέσω μιας εύχρηστης εφαρμογής GUI αλλά και από το τερματικό.

Το DeepSeek-R1 είναι ένα μεγάλο γλωσσικό μοντέλο (LLM) του κινεζικού εργαστηρίου τεχνητής νοημοσύνης με έδρα το Χανγκζού της Κίνας το οποίο ιδρύθηκε τον Ιούλιο του 2023. Το DeepSeek R1 κατάφερε να προσελκύσει την προσοχή όλων επειδή είναι δωρεάν και ανοιχτού κώδικα για οποιονδήποτε θέλει να μελετήσει και να βελτιώσει τον κώδικά του.

Πρόκειται για ένα «έτοιμο» σύστημα τεχνητής νοημοσύνης που διατίθεται δωρεάν σε αντίθεση με άλλα ισχυρά συστήματα, όπως το OpenAI, Claude Sonnet, το Google Gemini που έχουν διαθέσιμο δωρεάν πακέτο, αλλά οι δωρεάν εκδόσεις περιορίζονται σε παλαιότερα μοντέλα.

Επίσης, το σημαντικότερο όλων είναι ότι το DeepSeek δεν έχει περιορισμούς και μπορεί να λειτουργήσει στον υπολογιστή μας με μια απλή εγκατάσταση.

Εύλογα θα ρωτήσει κάποιος:

Γιατί να εγκαταστήσω το Deepseek όταν υπάρχει σε web εφαρμογή από την επίσημη σελίδα του;

Υπάρχουν 2 απαντήσεις:

- Γιατί έτσι….

- Γιατί η επίσημη ιστοσελίδα δεν παρέχει καμία εγγύηση για την ΜΗ συλλογή προσωπικών δεδομένων

Πριν προχωρήσουμε ας ξεκαθαρίσουμε κάποια πράγματα για τα διαφορετικά μεγέθη συλλογισμού.

Μια εξαιρετική ανάλυση από τον φίλο Αλέξη Διακογιάννη Software Architect σχετικά με το Deepseek είναι στο παρακάτω βίντεο:

Μοντέλα συλλογισμού, ποια είναι αυτά;

Τα μοντέλα συλλογισμού εκπαιδεύτηκαν να «σκέφτονται» πριν δώσουν μια τελική απάντηση.

Αυτό γίνεται χρησιμοποιώντας μια τεχνική που ονομάζεται «Chain-of-tought» (CoT). Η CoT είναι μια τεχνική που ενθαρρύνει τα μοντέλα να αναλύουν πολύπλοκα προβλήματα σε μικρότερα, πιο διαχειρίσιμα βήματα. Αυτό επιτρέπει στο μοντέλο να φτάσει σε μια τελική απάντηση μέσω μιας σειράς ενδιάμεσων βημάτων, αντί να προσπαθεί να λύσει το πρόβλημα με μια κίνηση. Το CoT του DeepSeek περιέχεται σε <think>…</think> tokens.

Όταν γίνεται μια μη τετριμμένη ερώτηση, τα μοντέλα DeepSeek θα ξεκινήσουν την απάντησή τους με ένα <think> token. Το περιεχόμενο στη συνέχεια θα μοιάζει συχνά με μια μακροσκελής ροή συλλογιστικής, όπου το μοντέλο εργάζεται βήμα προς βήμα στο πρόβλημα. Μετά το token </think> κλεισίματος , το μοντέλο αρχίζει να δημιουργεί κανονικό περιεχόμενο, το οποίο είναι η τελική απάντηση στην ερώτηση.

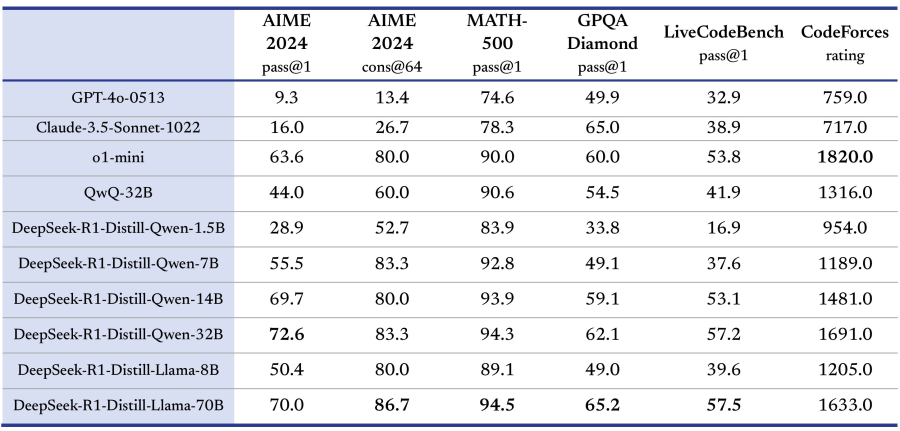

Σύμφωνα λοιπόν με πολλά δημοφιλή benchmark, όπως το AIME 2024, το MATH-500 και το CodeForces, το ανοιχτού κώδικα 671Β παραμέτρων μοντέλο DeepSeek-R1 αποδίδει συγκρίσιμα αποτελέσματα με το πλήρους μεγέθους συλλογιστικό μοντέλο του OpenAI. Τα μικρότερα «αποσταγμένα» μοντέλα συλλογισμού DeepSeek-R1 αποδίδουν συγκρίσιμα με τα μοντέλα συλλογιστικής o1-mini του OpenAI.

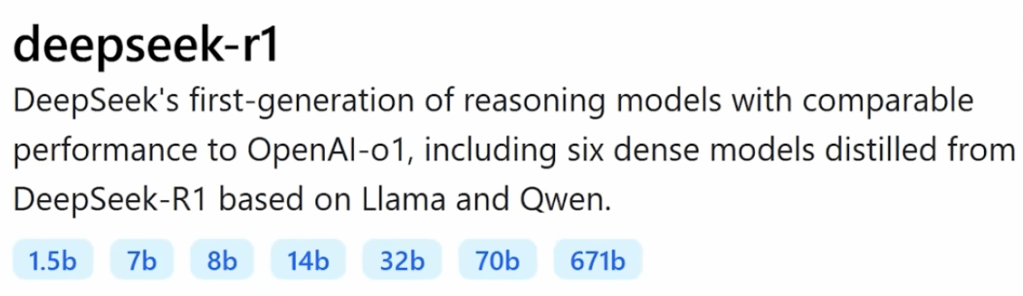

Η «απόσταξη» ή distilling του DeepSeek-R1 σημαίνει:

Παίρνουμε μικρότερα «πυκνότερα μοντέλα» όπως το Llama3 και το Qwen2.5 και τα βελτιστοποιούν χρησιμοποιώντας αντικείμενα που δημιουργούνται από ένα μεγαλύτερο μοντέλο, με σκοπό να «ενσταλάξουν» σε αυτά δυνατότητες που μοιάζουν με το μεγαλύτερο μοντέλο.

Τα διαφορετικά μοντέλα π.χ. 1.5Β, 7Β, 14Β, 32Β, 617Β είναι οι παράμετροι σε μονάδες δισεκατομμυρίων. Για την απλότητα του ζητήματος φανταστείτε ότι είναι σαν iQ και άρα όσο πιο μικρό, τόσο περισσότερο «χαζούλι» είναι. Ένα σύγχρονο PC μπορεί να τρέξει το μοντέλο 7Β και ίσως και το 14Β, ανάλογα και με την κάρτα γραφικών του (το 14b μπορεί να τρέξει σε άνετα σε Nvidia 4090 ενώ το 32b ίσως το ζορίσει).

Πως κάνουμε εγκατάσταση το Deepseek;

Υπάρχουν 2 εύκολοι τρόποι για την εγκατάσταση. Η μια είναι μέσω το LM Studio και η άλλη από το τερματικό μέσω του Ollama

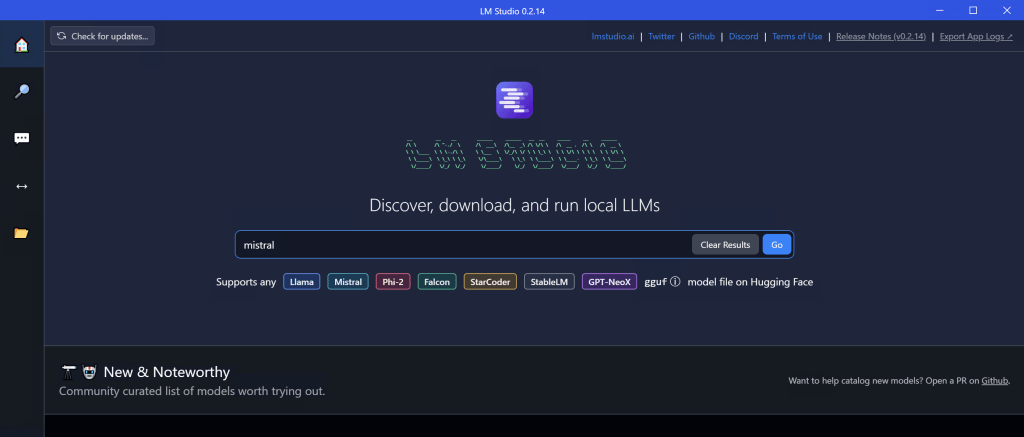

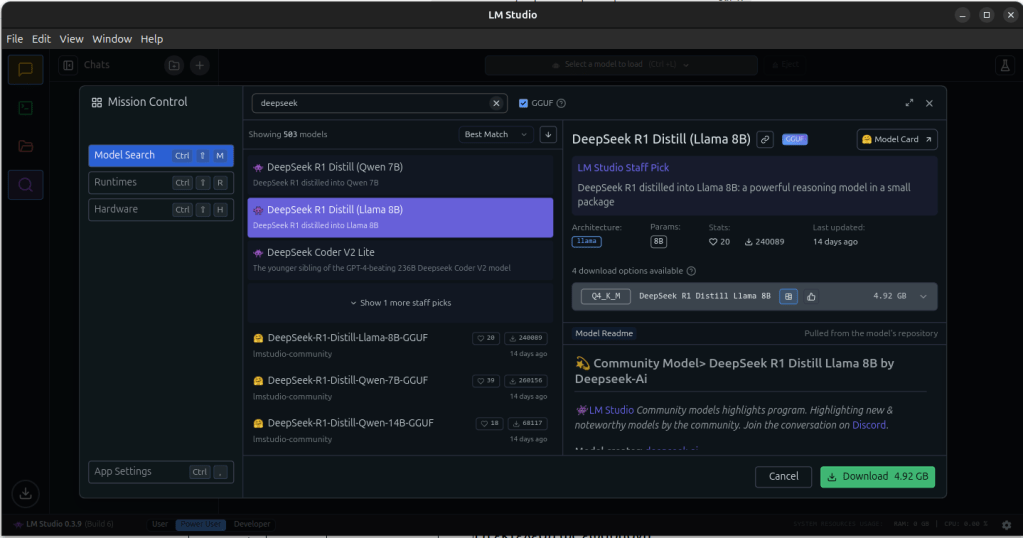

Το LM Studio είναι ένα άλλο εργαλείο για χρήση τοπικής αλληλεπίδρασης με LLMs. Παρέχει ένα ευρύτερο φάσμα λειτουργιών, όπως η αναζήτηση, η λήψη και η εκτέλεση τοπικών LLM, με ενσωματωμένες διεπαφές συνομιλίας (chat) και συμβατότητα με τοπικούς διακομιστές LLM. Γενικά θεωρείται πιο φιλικό περιβάλλον από το Ollama και προσφέρει επίσης μεγαλύτερη ποικιλία επιλογών μοντέλων.

Από την άλλη το Ollama είναι ένα εργαλείο ειδικά σχεδιασμένο για να βοηθά τους χρήστες στην αλληλεπίδραση με μεγάλα γλωσσικά μοντέλα (LLM) τοπικά. Προσφέρει ευελιξία στη δημιουργία προσαρμοσμένων μοντέλων γλώσσας και στην εκτέλεση πολλών προεκπαιδευμένων μοντέλων. Επιπλέον, είναι εξ ολοκλήρου ανοιχτού κώδικα, προάγοντας τη διαφάνεια και τη συμμετοχή της κοινότητας. Μπορείτε να εκτελέσετε μοντέλα χρησιμοποιώντας τη γραμμή εντολών Olama απευθείας από το τερματικό. Αλλά υπάρχουν και διεπαφές web περιβάλλοντων παρόμοια με την εμπειρία που θα είχατε με το ChatGPT. Στο παρόν οδηγό θα παραμείνουμε στην έκδοση του τερματικού αλλά για όποιον ενδιαφέρεται για web interface του ollama υπάρχει μια λίστα εδώ.

Εγκατάσταση Deepseek μέσω του LM Studio

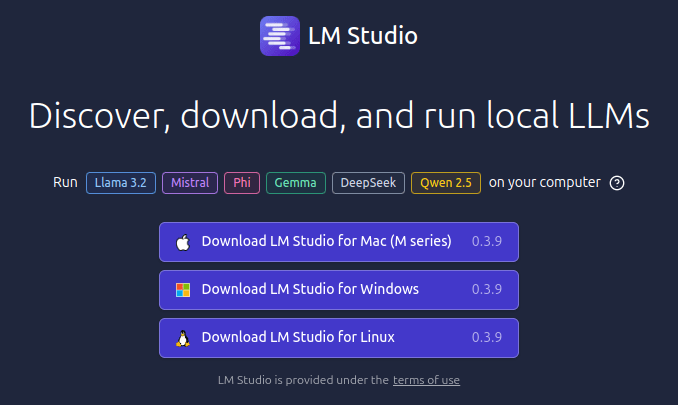

Για την εγκατάσταση του Deepseek μέσω του LM Studio θα χρειαστεί να εγκαταστήσουμε το LM Studio:

Κατεβάζεται την έκδοση ανάλογα με το λειτουργικό σας. Στο Linux χρησιμοποιούν .appimage οπότε θα χρειαστεί να ενεργοποιηθεί ως executable με δεξί κλικ πάνω του –> ιδιότητες –> Δικαιώματα –> Να επιτρέπεται η εκτέλεση ως εφαρμογή.

Αφού το ανοίξετε, κάντε κλικ στο κουμπί αναζήτησης «Deepseek» και επιλέξτε το μοντέλο που είναι συμβατό με το hardware σας (θα επιλεχτεί αυτόματα) και με το μέγεθος που θέλετε να κατεβάσετε το.

Στη συνέχεια δημιουργήστε ένα chat και ξεκινήστε με απλές ερωτήσεις και σταδιακά δυσκολέψτε τις.

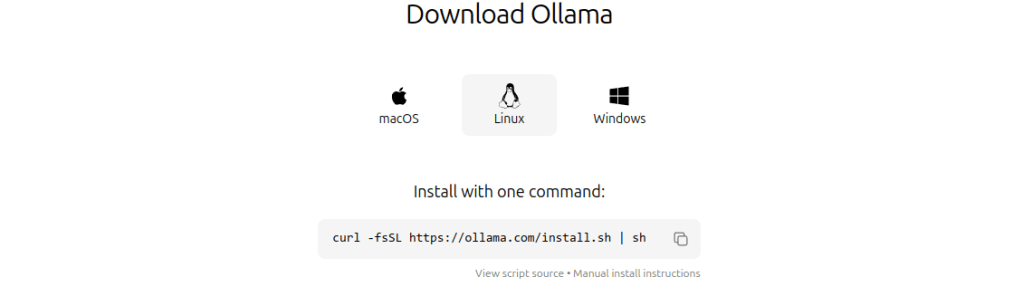

Εγκατάσταση Deepseek μέσω του Ollama

Για την εγκατάσταση του Deepseek μέσω του Ollama θα χρειαστεί να εγκαταστήσετε πρώτα το Ollama

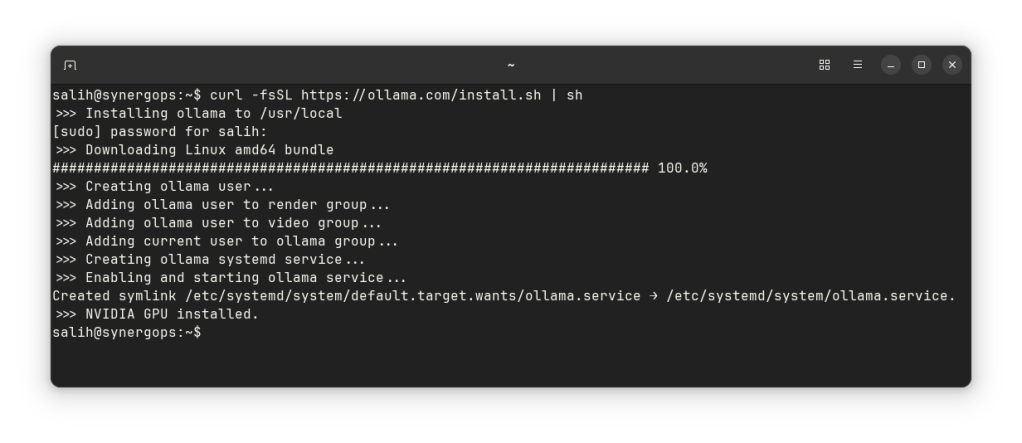

Αφού το κατεβάσετε ακολουθείστε τις οδηγίες εγκατάστασης ανάλογα με το λειτουργικό σας. Αν έχετε ενεργοποιήσει το WSL του Windows ή έχετε Linux ανοίξτε ένα τερματικό και τρέξτε :

curl -fsSL https://ollama.com/install.sh | sh

Στη συνέχεια τρέξτε ollama -h στο τερματικό για να δείτε ότι τρέχει σωστά εμφανίζοντας σας οδηγίες χρήσης.

Τέλος πάμε στην σελίδα των μοντέλων του Ollama

και επιλέγουμε το κατάλληλο για το hardware μας (όπως αναφέραμε πιο πάνω) μοντέλο και το κατεβάζουμε με βάση το όνομά του

π.χ. για το μικρότερο:

ollama run deepseek-r1:1.5b

ενώ αν έχετε πιο σύγχρονη κάρτα γραφικών ή ακόμα και μια Nvidia 4090 δοκιμάστε την 14b το οποίο είναι 9GB σε μέγεθος και με μια 100ρα γραμμή θα το έχετε περίπου σε 10 λεπτά.

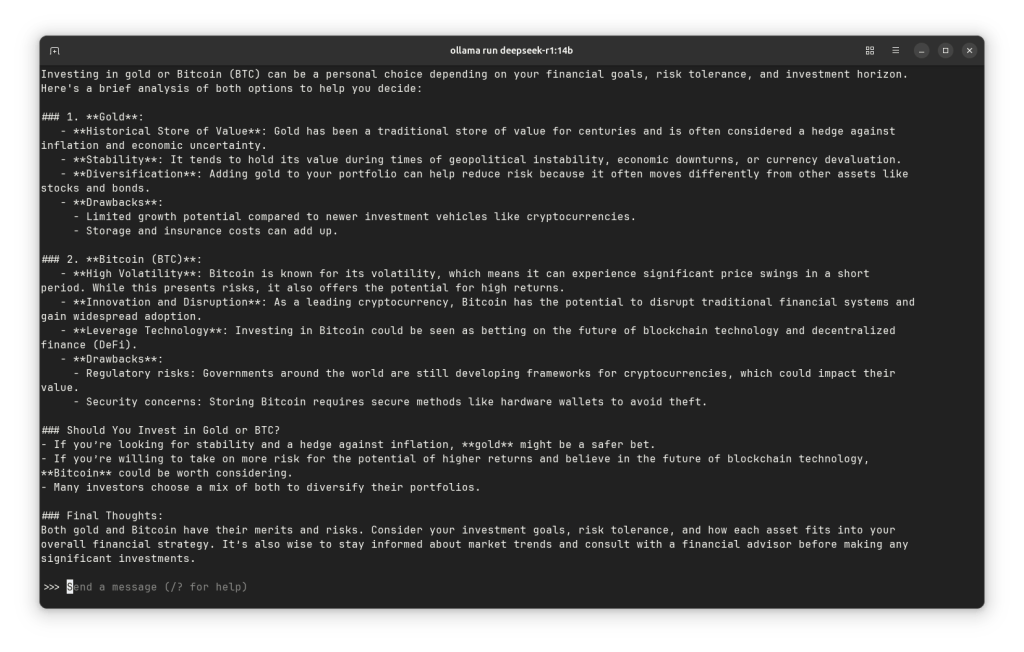

Μετά το πέρας της εγκατάστασης θα ξεκινήσει το chat αυτόματα όπου θα δείτε το prompt:

>>> Send a message (/? for help)

Ξεκινήστε με απλές ερωτήσεις και στην συνέχεια κάντε και πιο δύσκολες.

Για να δείτε κάποιες παραμέτρους μπορείτε να πληκτρολογήστε στο promt:

>>> /?

Για να τερματίσετε την συνεδρία γράφετε:

>>> /bye

Για να το τρέξετε πάλι, ξανατρέχετε την εντολή ollama run deepseek-r1:μοντελο που χρησιμοποιήσατε. Μην ανησυχείτε, δεν θα το ξανακατεβάσει από την αρχή εκτός και αν υπάρχει κάποια ενημέρωση.

Αξίζει το Deepseek να το έχω στο PC μου;

Αυτό είναι εντελώς υποκειμενικό. Προσωπικά προτιμώ να τρέχω κάτι που βασίζεται σε ελεύθερο λογισμικό και είναι στον υπολογιστή μου.

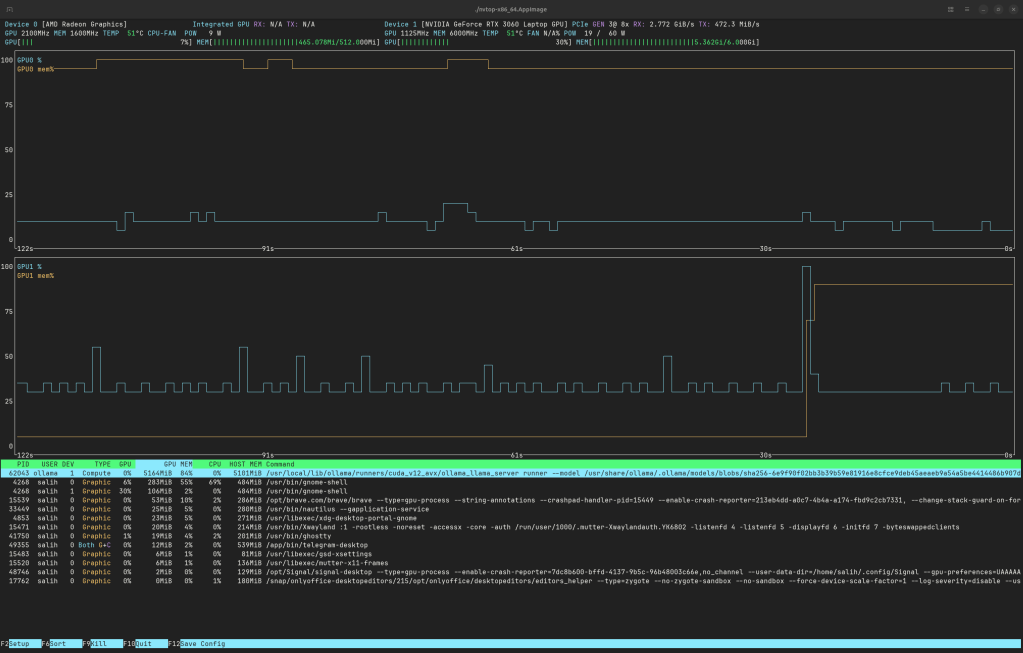

Φυσικά το μοντέλο 14b που τρέχω ζορίζει την κάρτα γραφικών μου και έχει τιγκάρει την RAM του, αλλά χαλάλι του…

ΕΞΑΙΡΕΤΙΚΟ

Νά σε καλά !

Ο ορισμός του «Στα εξηγώ ωραία;» :)

Ευχαριστούμε!

Χαίρομαι που σε βοήθησε !

Πολύ χρήσιμο άρθρο, ευχαριστούμε πολύ! Μια απορία, πώς μπορούμε να βρούμε ποια έκδοση είναι η πιο κατάλληλη για το hardware μας; (Π.χ. τι θα ταίριαζε σε laptop 11ετίας με επεξεργαστή Intel Core i5-2450M, με έξτρα κάρτα γραφικών NVIDIA GeForce GT 740M και με 8 GB RAM)

Δοκίμασε την 1.5b

…biast υπάρχει ακριβώς όσο στα υπόλοιπα αλλά δεν υπάρχει πάντα…

…σωστά, δεν υπάρχουν καλύτερα αλλά νομίζω πως το deepseek ήρθε για να «ταράξει τα νερά», να μπουστάρει λίγο την κατάλληλη στιγμή και να εξελιχθεί μέσω του μεγαλύτερου ανταγωνισμού βελτιώνοντας συνέχεια το NLP…

…απλά το deepseek πήρε το ρόλο του «wake up»

Συμφωνώ. ΤΟ Deepseek ήτα το «χαστούκι¨ που χρειαζόταν να ξεκουνηθούν απο τα καλάμια τους

… Επανέρχομαι γιατί το θεωρώ σημαντικό… Το Deepseek σε API έγινε αντικειμενικό – νομίζω. Τουλάχιστον στα ίδια ερωτήματα απάντησε όπως έπρεπε… όχι όπως τα άλλα… Μένει να δούμε στο μέλλον τις προθέσεις των κινέζων όσο αφορά τα API…

Πράγματι πολύ σημαντικό αυτό που θέτεις. Φαντάζομαι όχι μόνο οι Κινέζοι, αλλά όλοι όσοι ασχολούνται με τον τομέα, θα δημιουργήσουν ακόμα καλύτερα API

μπράβο Σαλίχ!

ποιες είναι οι ελαχιστες προϋποθέσεις :

CPU, GPU, RAM, μεγάθους δίσλου

για να τρέξει άνετα στο σύστημά μας, το μοντέλο 14b

μέσω του LM Studio;;;;;

για το 14b θες λογικά κάτι σε Nvidia 3060 και πάνω, Ram πάνω απο 8GB και θα χρησιμοποιήσει περίπου 10GB χώρο στον δισκο σου

Ευχαριστούμε!

Ερώτηση: τα updates γίνονται αυτόματα, ή όταν δημοσιεύεται νέα έκδοση του Deepseek θα πρέπει να κάνουμε εκ νέου εγκατάσταση;

Αν χρησιμοποιείς το Olama τότε ένα `olama pull`

Δες και εδω τι προσπαθούν να κάνουν https://github.com/ollama/ollama/issues/1890

Καταπληκτικός όπως σε έχουμε και μας έχεις συνηθίσει! Πολύ ωραία δουλειά, ευχαριστούμε πολύ! :)

Να είσαι καλά